Rete neurale ricorrente: funzionamento e struttura

Una rete neurale ricorrente è una rete in grado di sfruttare connessioni di feedback e creare una sorta di memoria. Questa tecnologia è utilizzata in particolare per gestire dati sequenziali e richiede un lavoro di addestramento piuttosto notevole.

Che cos’è una rete neurale ricorrente?

Una rete neurale ricorrente (RNN) è una rete neurale artificiale che può creare connessioni di feedback e quindi sfruttare le informazioni di output come nuovi input. Questo metodo è particolarmente utile nei casi in cui occorre elaborare dati sequenziali nel campo del deep learning e dell’IA. In inglese, queste reti sono dette Recurrent Neural Network (RNN). Grazie alla capacità di acquisire informazioni dagli input precedenti, la rete neurale ricorrente sviluppa una specie di memoria ed è in grado di modificare l’output a seconda degli elementi precedenti all’interno di una sequenza. Esistono diversi tipi di connessioni di feedback. Ne deriva che queste reti offrono maggiori possibilità, ma anche l’addestramento si fa più impegnativo.

- Siti web in tempo record

- Soluzioni IA per il tuo business

- Risparmio di tempo e risultati eccellenti

Come funzionano le reti neurali ricorrenti?

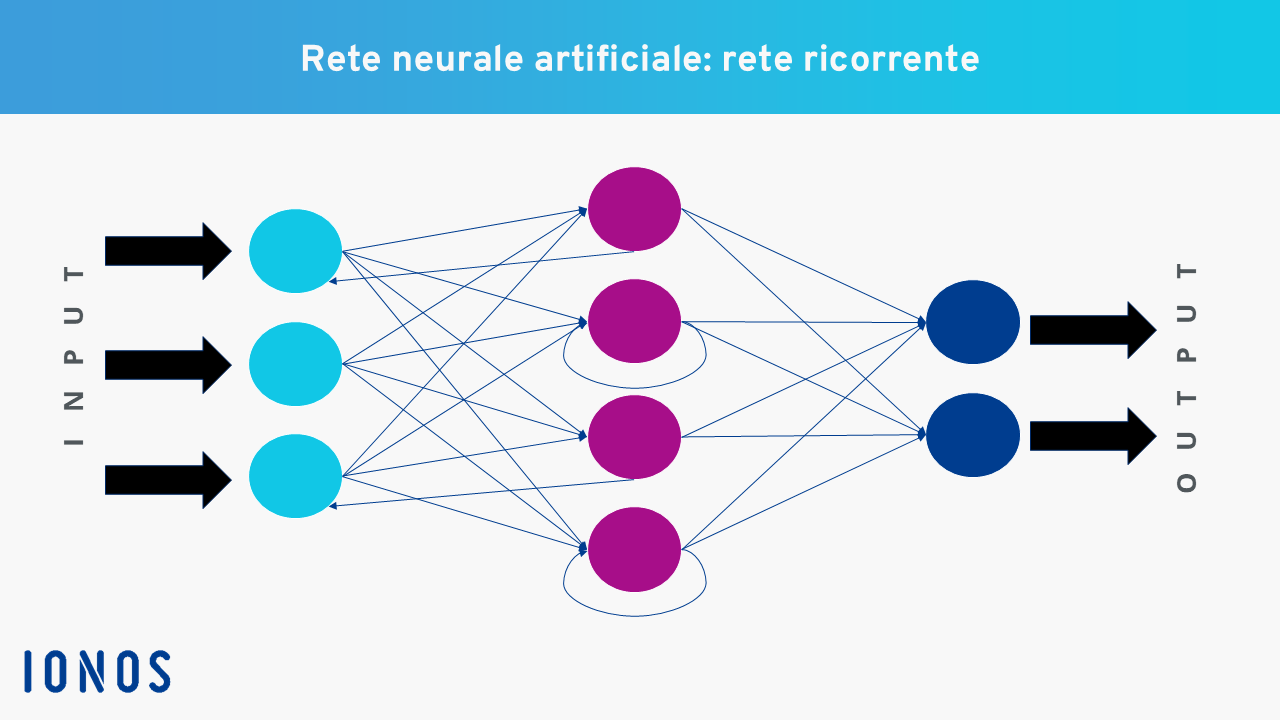

A prima vista, le reti neurali ricorrenti hanno una struttura simile alle altre reti neurali. Sono costituite da almeno tre strati diversi (in inglese, “layer”), che a loro volta contengono neuroni (nodi) collegati tra loro tramite i bordi. Si parla quindi di strato di ingresso (“input layer”), strato di uscita (“output layer”) e di un numero qualsiasi di strati intermedi, noti anche come “hidden layer”.

- Strato di ingresso: questo strato acquisisce le informazioni dal mondo esterno, che vengono poi ponderate e trasmesse allo strato immediatamente superiore.

- Strato intermedio: si tratta dei cosiddetti hidden layer. Qui le informazioni vengono trasmesse e nuovamente ponderate. Questa operazione avviene a ogni strato ulteriore e in modo invisibile, motivo per cui si parla anche di strati nascosti.

- Strato di uscita: le informazioni analizzate o modificate vengono quindi emesse dall’output layer. Questo output è il risultato finale oppure funge da input per altri neuroni.

La particolarità di una rete neurale ricorrente è la sua capacità di stabilire da sola la direzione del flusso di informazioni. L’output di un neurone non deve necessariamente attraversare una connessione di feedback verso lo strato immediatamente superiore, ma può anche essere utilizzato come input dallo stesso neurone, da un neurone nello stesso strato o da un neurone nello strato precedente. Il parametro di ponderazione è lo stesso in ogni strato. Esistono quattro diverse categorie di connessioni di feedback:

- Feedback diretto: in una connessione di feedback diretto il neurone utilizza il proprio output come input.

- Feedback indiretto: in una connessione di feedback indiretto l’uscita di un neurone viene collegata a uno strato precedente.

- Feedback laterale: in una connessione di feedback laterale l’uscita di un neurone è collegata all’input di un altro neurone nello stesso strato.

- Feedback completo: in una connessione di feedback completo tutte le uscite dei neuroni sono collegate ad altri neuroni.

Come si addestra una rete neurale ricorrente?

L’addestramento delle reti neurali ricorrenti è molto più complicato in quanto spesso non è possibile sfruttare le informazioni risalenti a molto tempo prima oppure è possibile farlo in maniera insufficiente. Per risolvere questo problema, si lavora spesso con funzioni come la memoria a breve-lungo termine (LSTM). In questo modo le informazioni vengono memorizzate più a lungo. Con il giusto addestramento, una rete neurale ricorrente è in grado di distinguere le informazioni importanti da quelle non importanti e può quindi reintrodurle nella rete.

Quali architetture esistono?

Sono diverse le architetture che differenziano le reti neurali ricorrenti l’una dall’altra. Le tipologie più comuni sono le seguenti:

- One to many: in questo caso, la rete neurale ricorrente riceve un input e restituisce diversi output. Un esempio pratico di questa tipologia è la generazione della didascalia di un’immagine partendo da una singola parola chiave.

- Many to one: in questo caso, più ingressi sono assegnati a una singola uscita. Questo principio è utilizzato, ad esempio, nell’analisi del sentiment per prevedere il riscontro sulla base di referenze.

- Many to many: questa architettura utilizza più input per ottenere anche più output. La loro quantità non deve essere necessariamente la stessa. Questa tecnica è utilizzata, ad esempio, per la traduzione da una lingua all’altra.

Quali sono i principali campi di applicazione di una rete neurale ricorrente?

Le reti neurali ricorrenti sono particolarmente utili quando il contesto è importante per l’elaborazione delle informazioni. Questo è particolarmente vero nella gestione di dati sequenziali che si presentano in una sequenza specifica o in ordine cronologico. In questi casi, le RNN possono prevedere meglio un risultato grazie al contesto degli input precedenti. Questa tecnologia è quindi indicata, ad esempio, per le seguenti applicazioni:

- Previsioni e dati di serie temporali: le RNN sono utilizzate spesso per prevedere eventi o valori sulla base di dati storici, come nelle analisi dei mercati finanziari, nelle previsioni meteorologiche o del consumo energetico.

- Elaborazione del linguaggio naturale: le reti neurali ricorrenti si dimostrano particolarmente utili nel campo del cosiddetto Natural Language Processing (NLP), ossia l’elaborazione del linguaggio naturale. Sono utilizzate, ad esempio, per attività quali la traduzione automatica, la modellazione linguistica, il riconoscimento del testo e la generazione automatica di testi.

- Riconoscimento vocale: le RNN svolgono un ruolo fondamentale nella tecnologia di riconoscimento vocale, dove sono utilizzate per convertire il linguaggio parlato in testo scritto. Ad esempio, queste applicazioni sono sfruttate dagli assistenti digitali e dai servizi di trascrizione automatica.

- Analisi di immagini e video: sebbene le reti neurali ricorrenti siano usate principalmente per l’elaborazione di dati sequenziali, possono essere utilizzate anche nell’analisi e soprattutto nell’elaborazione di immagini e video, ad esempio per la creazione di filmati riepilogativi o per il rilevamento di attività nei video di sorveglianza.

Quali sono le differenze rispetto a una rete neurale feed-forward (FNN)?

Una rete neurale ricorrente è un ulteriore sviluppo della rete neurale feed-forward (FNN), che invece non utilizza nessuna connessione di feedback. In una FNN le informazioni sono trasmesse in una sola direzione, ossia verso lo strato immediatamente superiore. Pertanto, in questo caso non è possibile reimmettere un’informazione all’indietro nella rete. La rete neurale feed-forward è in grado di riconoscere schemi, ma non può utilizzare informazioni che sono già state elaborate.