Riconoscimento vocale automatico: cos’è l’automatic speech recognition (ASR)?

Il riconoscimento vocale automatico è un processo di conversione automatica del parlato in testo. Le tecnologie ASR utilizzano metodi di apprendimento automatico per analizzare ed elaborare i modelli vocali e riprodurli sotto forma di testo. Il riconoscimento automatico del parlato si presta a un’ampia gamma di applicazioni, dagli assistenti linguistici virtuali alla generazione di sottotitoli per i video fino alla trascrizione di riunioni importanti.

Che cos’è il riconoscimento vocale automatico?

Il riconoscimento vocale automatico, in inglese “automatic speech recognition” (ASR), è un ramo dell’informatica e della linguistica computazionale che si occupa di sviluppare metodi per tradurre automaticamente il linguaggio parlato in una forma leggibile dalle macchine. Quando la conversione avviene in formato testuale, si parla anche di speech to text (STT). I processi ASR si basano su modelli statistici e algoritmi complessi.

La precisione di un sistema ASR viene misurata dal cosiddetto tasso di errore delle parole (WER: “word error rate”), che mette in rapporto gli errori (cioè il numero di parole omesse, aggiunte o riconosciute erroneamente) con il numero totale delle parole pronunciate. Più basso è questo valore, maggiore è la precisione del riconoscimento vocale automatico. Ad esempio, un tasso di errore del 10% corrisponde a una precisione del 90%.

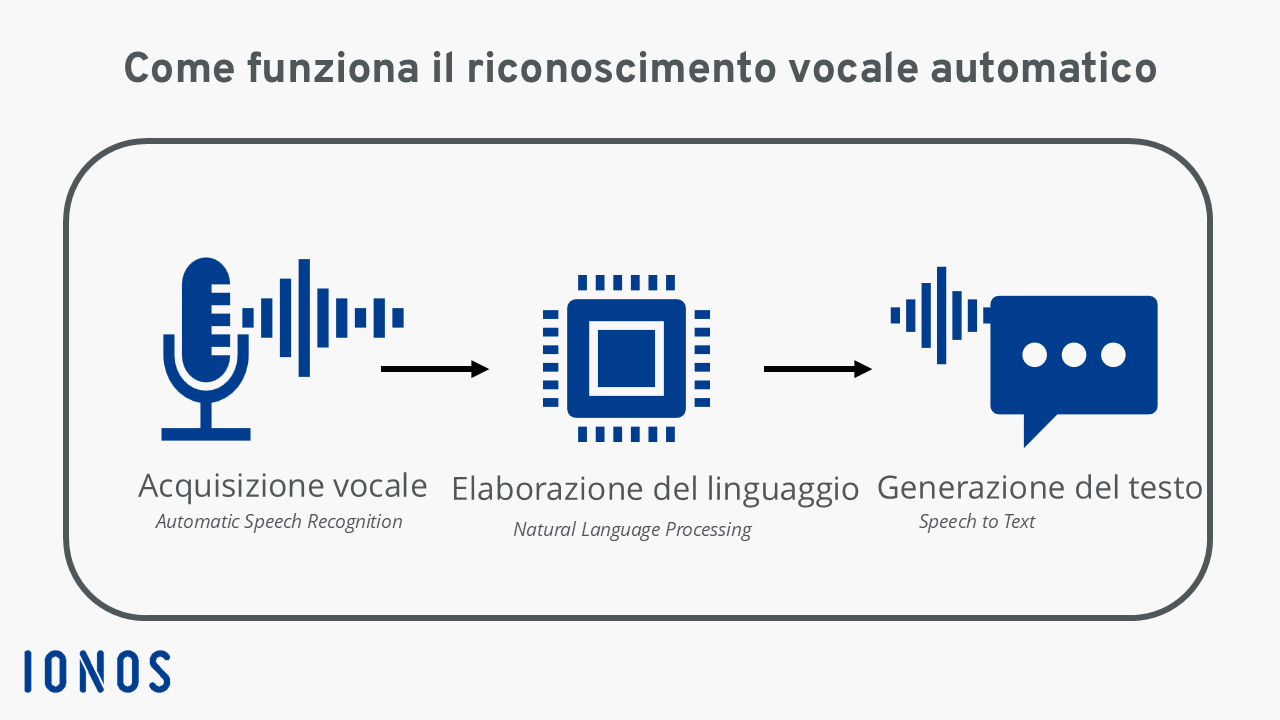

Come funziona il riconoscimento vocale automatico?

Il processo di riconoscimento vocale automatico è composto da diversi passaggi consecutivi che si integrano perfettamente tra di loro. Di seguito trovi una spiegazione dettagliata delle varie fasi:

- Acquisizione vocale (automatic speech recognition): il sistema acquisisce la voce parlata tramite un microfono o un’altra sorgente audio.

- Elaborazione del linguaggio (natural language processing (NPL)): in primo luogo, la registrazione vocale viene ripulita dai rumori di fondo. Un algoritmo analizza poi le caratteristiche fonetiche e fonemiche del parlato. Dopodiché, le caratteristiche registrate vengono confrontate con modelli precedentemente addestrati per identificare le singole parole.

- Generazione del testo (speech to text): infine, il sistema trasforma i suoni riconosciuti in forma testuale.

Algoritmi ASR: approccio ibrido e deep learning a confronto

Esistono fondamentalmente due approcci principali per il riconoscimento vocale automatico. Mentre in passato venivano utilizzati soprattutto approcci ibridi classici, come i modelli di Markov nascosti (HMM: hidden Markov models), oggi si ricorre sempre più spesso alle tecnologie di deep learning. Questo è dovuto al fatto che ultimamente la precisione dei modelli tradizionali ha smesso di migliorare.

Approccio ibrido classico

I modelli classici richiedono dati allineati forzatamente, il che significa che utilizzano la trascrizione testuale di un segmento vocale per determinare in che punto compaiono determinate parole. L’approccio ibrido tradizionale combina sempre un modello lessicale, un modello acustico e un modello linguistico per trascrivere il parlato:

- Il modello lessicale definisce la pronuncia fonetica delle parole. Richiede la creazione di un set di dati o un insieme di fonemi per ogni lingua.

- Il modello acustico mira a modellare i pattern acustici del linguaggio. Utilizzando dati allineati forzatamente, prevede quali suoni o fonemi sono associati ai diversi segmenti vocali.

- Il modello linguistico apprende quali sequenze di parole sono più probabili in una lingua. Il suo compito è quello di prevedere quali parole seguiranno le parole correnti e con quale probabilità.

Uno dei principali svantaggi dell’approccio ibrido è che utilizzando questo metodo risulta difficile aumentare la precisione del riconoscimento vocale. Inoltre, è necessario addestrare tre modelli separati, il che si rivela molto dispendioso in termini di tempo e costi. Ciononostante, molte aziende scelgono ancora questa opzione, dato che esiste già un’ampia conoscenza su come creare un modello affidabile utilizzando questo approccio classico.

Deep learning con processi end-to-end

I sistemi end-to-end hanno la capacità di trascrivere direttamente una sequenza di caratteristiche vocali in ingresso. L’algoritmo apprende come convertire le parole parlate utilizzando grandi quantità di coppie di dati, come ad esempio file audio contenenti una frase specifica e la sua trascrizione corretta.

Le architetture di apprendimento profondo come CTC, LAS e RNNT possono essere addestrate in modo da fornire risultati precisi anche senza l’uso di dati allineati forzatamente, modelli lessicali e linguistici. Tuttavia, molti sistemi di deep learning vengono comunque collegati a un modello linguistico, poiché questo può aiutare a migliorare ulteriormente la precisione della trascrizione.

Nel nostro articolo di confronto tra deep learning e machine learning spieghiamo nel dettaglio le differenze principali tra i due concetti.

L’approccio end-to-end per il riconoscimento vocale automatico non solo consente di ottenere punti con una precisione maggiore rispetto ai modelli convenzionali. Un altro vantaggio è che i sistemi ASR sono più facili da addestrare e richiedono meno lavoro umano.

Riconoscimento vocale automatico: quali sono i principali campi di applicazione?

Grazie soprattutto ai progressi nel campo dell’apprendimento automatico, il riconoscimento vocale automatico può essere utilizzato in diversi settori per aumentare l’efficienza, migliorare la soddisfazione della clientela e/o incrementare il ritorno sugli investimenti (ROI). Tra i principali campi di applicazione troviamo:

- Telecomunicazioni: i contact center utilizzano le tecnologie ASR per trascrivere le conversazioni con la clientela e analizzarle. Le trascrizioni accurate risultano utili anche per il monitoraggio delle chiamate e per le soluzioni telefoniche realizzate con server cloud.

- Piattaforme video: la creazione di sottotitoli in tempo reale sulle piattaforme video è ormai uno standard del settore. Il riconoscimento vocale automatico è inoltre utile per la categorizzazione dei contenuti.

- Monitoraggio dei media: le API ASR consentono di analizzare trasmissioni televisive, podcast, programmi radiofonici e altri media per determinare quante volte vengono menzionati determinati marchi o temi.

- Videoconferenze: le trascrizioni accurate delle riunioni, fornite da soluzioni software come Zoom, Microsoft Teams e Google Meet, permettono di effettuare analisi più approfondite, ottenere intuizioni chiave e adottare conseguentemente misure adatte. Il riconoscimento vocale automatico può essere utilizzato anche per fornire sottotitoli in tempo reale durante le videoconferenze.

- Assistenti vocali: gli assistenti virtuali come Amazon Alexa, Assistente Google e Siri di Apple si basano sul riconoscimento vocale automatico. Questa tecnologia consente agli assistenti di rispondere a domande, eseguire compiti e interagire con altri dispositivi.

Qual è il ruolo dell’intelligenza artificiale nelle tecnologie ASR?

L’intelligenza artificiale contribuisce a migliorare la precisione e la funzionalità generale dei sistemi ASR. In particolare, lo sviluppo di modelli linguistici di grandi dimensioni ha reso possibile una migliore elaborazione del linguaggio naturale. Un modello linguistico di grandi dimensioni (LLM) non è solo in grado di creare o tradurre testi complessi con grande pertinenza, ma riconosce anche il linguaggio parlato. Pertanto, i sistemi ASR beneficiano enormemente di questi sviluppi. Inoltre, l’intelligenza artificiale è utile anche nello sviluppo di modelli linguistici specifici per diversi accenti.

- Siti web in tempo record

- Soluzioni IA per il tuo business

- Risparmio di tempo e risultati eccellenti

Quali sono i punti di forza e di debolezza del riconoscimento vocale automatico?

Rispetto alla trascrizione tradizionale, il riconoscimento vocale automatico offre diversi vantaggi. Una delle principali forze dei moderni sistemi ASR è la loro elevata precisione, dovuta al fatto che tali sistemi possono essere addestrati con grandi quantità di dati. Questo consente di migliorare la qualità dei sottotitoli e delle trascrizioni e di fornirli in tempo reale.

Un altro importante vantaggio è l’aumento dell’efficienza. Il riconoscimento vocale automatico consente alle aziende di scalare, ampliare più rapidamente la propria gamma di servizi e offrirli a un pubblico più vasto. Gli strumenti di riconoscimento vocale automatico facilitano a studentesse, studenti, professioniste e professionisti la documentazione dei contenuti audio, come ad esempio una riunione aziendale o una lezione universitaria.

D’altro canto, uno svantaggio è che, sebbene i sistemi ASR siano più precisi che mai, non sono ancora in grado di raggiungere la precisione umana. Questo è dovuto principalmente alle numerose sfumature della lingua parlata. Le sfide principali sono rappresentate da accenti, dialetti, diverse intonazioni, oltre che da rumori di fondo. Anche i modelli di deep learning più avanzati non riescono a gestire tutti i casi particolari. Inoltre, un’ulteriore problematica rilevante è che le tecnologie ASR spesso elaborano dati personali, sollevando preoccupazioni sulla privacy e la sicurezza dei dati.